Der Aufstieg des Super-CRO – und welche Architektur sie unter DORA brauchen

FICO

von Mike Trkay, FICO

Die Rolle des Chief Risk Officer in Banken hat sich grundlegend verändert. Neben klassischen Finanzrisiken wie Kredit- und Marktrisiken stehen heute IKT-Risiken, Auslagerungen, ESG, Cybersicherheit und künstliche Intelligenz im Fokus. Regulatorische Anforderungen unter MaRisk, EZB-Aufsicht und DORA verlangen, dass CROs Risiken über Systemgrenzen hinweg verstehen und bewerten.

Entscheidend ist nicht mehr nur Governance, sondern die Fähigkeit, Risiken entlang von Datenflüssen und Systemabhängigkeiten transparent zu machen.“

Dabei entsteht ein strukturelles Spannungsfeld: Die Verantwortung bleibt in der ersten Verteidigungslinie, also den operativen Geschäfts- und IT-Einheiten, während der CRO Risiken unabhängig challengen muss. Hier zeigt sich der Aufstieg des „Super-CRO“: nicht als einzelner Experte für alle Risiken, sondern als Orchestrator von Governance, Erkenntnissen und kritischer Prüfung im gesamten Unternehmen.

Cyberrisiko: Verantwortung ohne Kontrolle

Cybersicherheit ist heute eines der dominierenden Risiken. Mit DORA steigt der Druck auf CROs, auch hier die Gesamtverantwortung zu übernehmen. Gleichzeitig liegt die operative Steuerung beim CISO, der über die notwendigen technischen Werkzeuge und Daten verfügt.

Cyberrisiken lassen sich jedoch nur dann belastbar bewerten, wenn sie auf einer konsistenten Datenbasis abgebildet werden und eine durchgängige Nachvollziehbarkeit von Daten und Entscheidungen gewährleistet ist.“

Mike Trkay kam 2013 zu FICO (Website) und ist CIO. Er verfügt über mehr als 25 Jahre Erfahrung im Aufbau skalierbarer Technologieplattformen und -organisationen. Zuvor war er in einer Reihe vonUnternehmen mit Verantwortlichkeiten für Cloud Computing, Kundensupport, Informationstechnologie, Cybersicherheit, Produktentwicklung und künstliche Intelligenz tätig.

Mike Trkay kam 2013 zu FICO (Website) und ist CIO. Er verfügt über mehr als 25 Jahre Erfahrung im Aufbau skalierbarer Technologieplattformen und -organisationen. Zuvor war er in einer Reihe vonUnternehmen mit Verantwortlichkeiten für Cloud Computing, Kundensupport, Informationstechnologie, Cybersicherheit, Produktentwicklung und künstliche Intelligenz tätig.So war Trkay unter anderem VP für Global Technology bei NewsCorp und Director of Technology Services bei Warner Brothers Entertainment. Mike hat einen BS in Technik von Harvey Mudd.

Ein Beispiel dafür ist die Software Bill of Materials (SBOM) für Dritt- und Viertanbieter. Sie schafft Transparenz über verwendete Softwarekomponenten und ermöglicht es erstmals, Abhängigkeiten, Verwundbarkeiten und Risiken entlang der Lieferkette systematisch zu analysieren. Mit ihrer Hilfe lassen sich Risiken nicht nur erkennen, sondern auch technisch verorten und priorisieren.

KI: Vom Effizienztreiber zum Betriebsrisiko

Künstliche Intelligenz steigert die Effizienz, bringt aber gleichzeitig neue Risiken in operative Prozesse ein. Regulatoren fordern erklärbare, prüfbare und kontrollierbare Modelle, etwa solche, die Entscheidungen in Kreditvergabe, Betrugserkennung oder Risikobewertung unterstützen.

Das erfordert ein durchgängiges Management des Modelllebenszyklus, versionierte und nachvollziehbare Dokumentation sowie eine kontinuierliche Überwachung der Modellleistung und eine systemweite Beobachtbarkeit (Observability) der zugrunde liegenden Daten- und Modellprozesse.

Ziel ist es, Risiken wie Halluzinationen oder Modellabweichungen frühzeitig zu erkennen.“

Technisch kann dies durch manipulationssichere Protokollierung oder vergleichbare Ansätze unterstützt werden. Ergänzend helfen Bewertungsmechanismen wie ein Trust Score dabei, die Verlässlichkeit von Modellentscheidungen einzuschätzen. Die Umsetzung dieser Kontrollen liegt jedoch in den operativen und analytischen Funktionen der ersten Linie.

Echtzeitdaten steuern Entscheidungen – nicht isolierte Datensilos

Die zentrale Voraussetzung für wirksame Risikosteuerung ist eine konsistente Datenbasis. Traditionelle Ansätze wie Data Lakes stoßen hier an Grenzen. Sie sind oft vom operativen Entscheidungsprozess entkoppelt und erzeugen Verzögerungen, da Daten erst gesammelt und bereitgestellt werden müssen.

Moderne Architekturen setzen stattdessen auf Datenpipelines, die Informationen aus operativen Systemen in Echtzeit erfassen und verarbeiten. Diese Daten werden zu Features und Profilen verdichtet, die eine nahezu in Echtzeit verfügbare Entscheidungsgrundlage schaffen. Dadurch entsteht ein durchgängiger Datenfluss von der Quelle bis zur Entscheidung.

Als Ergebnis wird das Risikomanagement stärker in operative Systeme integriert, anstatt eine nachgelagerte analytische Funktion zu bleiben.“

Dies steht im Einklang mit dem Fokus von DORA auf operative Resilienz und den Bedarf an systemseitigen Fähigkeiten

Plattformen ermöglichen Integration

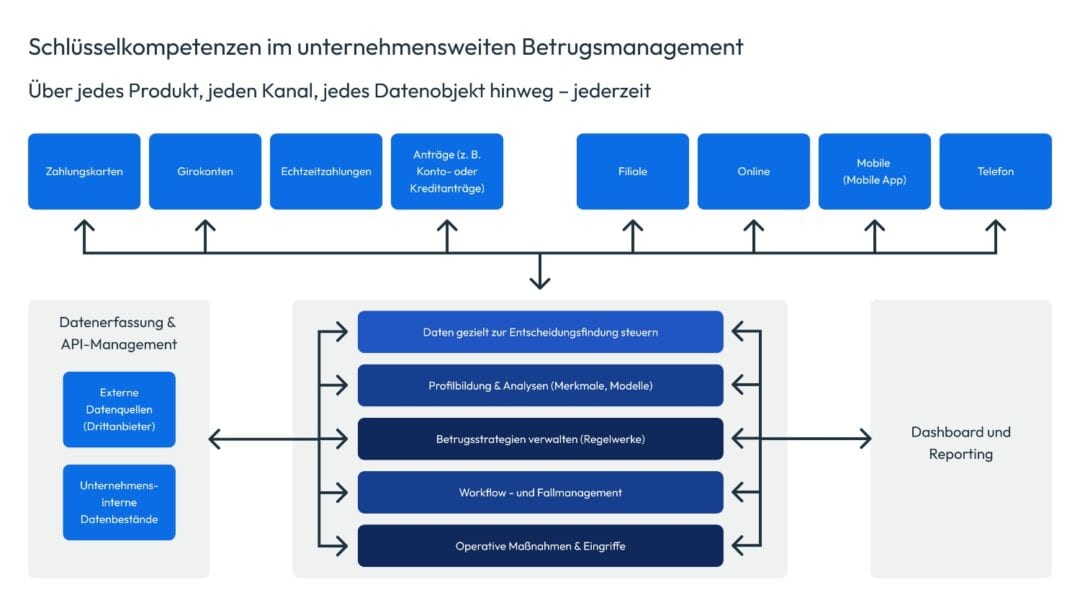

Mit der steigenden Zahl an Risikokategorien und Datenquellen gewinnen Plattformansätze rund um Decision-Intelligence-Plattformen an Bedeutung. Sie ermöglichen eine strukturierte Integration von Daten, schaffen einheitliche Entscheidungsgrundlagen und unterstützen die Zusammenarbeit zwischen Fachbereichen.

Solche Plattformen verbinden Datenintegration, Analyse und Entscheidungsprozesse. Sie stellen sicher, dass regulatorische Anforderungen, Risikoziele und geschäftliche Ziele auf derselben technischen Basis umgesetzt werden.

FICO

Markt vs. Marktfolge: Trennung bleibt, Systeme verbinden

MaRisk verlangt eine klare Trennung von Markt und Marktfolge. Diese Trennung wird jedoch zunehmend technisch überbrückt.

Gemeinsame Datenplattformen, konsistente Datenmodelle und klar definierte Zugriffs- und Kontrollmechanismen ermöglichen es beiden Seiten, auf derselben Datenbasis zu arbeiten.“

So kann die Risikofunktion in Echtzeit nachvollziehen, wie Entscheidungen in der ersten Linie entstehen, ohne ihre Unabhängigkeit des Front Office aufzugeben.

Fazit: Risikomanagement braucht die richtige Architektur

Die Rolle des CRO verschiebt sich grundlegend. Entscheidend ist nicht mehr nur Governance, sondern die Fähigkeit, Risiken über Daten, Systeme und Prozesse hinweg zu verstehen und zu steuern.

Ohne belastbare Datenarchitekturen, Echtzeit-Datenflüsse und integrierte Plattformen bleibt Risikomanagement fragmentiert.“

Deshalb investieren „Super-CROs“ in Plattformen, die die Zusammenarbeit bei der Entwicklung und Umsetzung von Strategien erleichtern. Mehrere Teams können so gemeinsam sicherstellen, dass Strategien ihre Risikoziele erfüllen, Wachstumsziele erreichen und regulatorische Anforderungen einhalten. Diese Technologie unterstützt den Wandel der Rolle des CRO von einer kontrollierenden und überwachenden Funktion hin zu einem aktiven Gestalter des Geschäfts. Mike Trkay, FICO

Sie finden diesen Artikel im Internet auf der Website:

https://itfm.link/243075

Schreiben Sie einen Kommentar