Backups ohne Compliance? Modernes Daten-Management in Zeiten von Ransomware und DSGVO

Cohesity

Ob neuartige IT-Angriffe, regulatorische Anforderungen oder Schutz kritischer Daten: Finanzdienstleister stehen mit guten Backups vor immer neuen Risiken. Mit aktuellen Ansätzen zur einheitlichen Datenverwaltung begegnen sie diesen Herausforderungen.

von Pascal Brunner, Field Technical Director, EMEA, bei Cohesity

Finanzdienstleister müssen ihren Betrieb ständig aufrechterhalten.

Es darf keine ungeplanten Unterbrechung im Service geben – sei es durch Ransomware, einen Unfall, Systemausfall oder staatlich geförderten Angriff.“

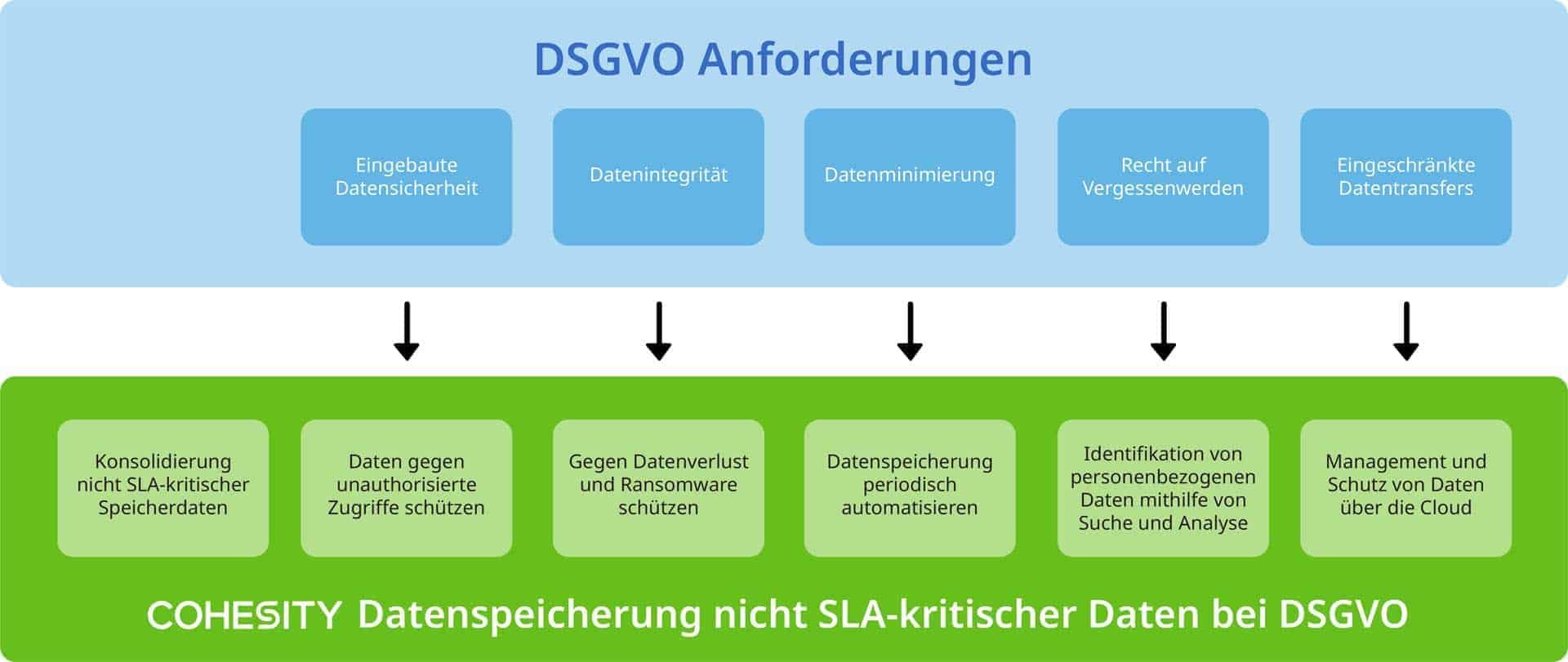

Zudem müssen sie eine Vielzahl von Vorschriften einhalten. Diese reichen von der EU-Datenschutz-Grundverordnung (DSGVO) und dem IT-Sicherheitsgesetz bis hin zu MIFID II oder PSD II.

Compliance ist auch für Backups wichtig

In Bezug auf die Compliance gibt es Anforderungen sowohl für Live-Produktionssysteme als auch für Backups. Zum Beispiel schreibt die DSGVO vor, dass Unternehmen personenbezogene Daten nicht länger aufbewahren dürfen als nötig. Einzelpersonen haben das Recht, die Entfernung ihrer Daten zu verlangen. Hier muss sichergestellt sein, dass eine Anwendung über ein Backup keine Daten erneut erhält, die bereits gelöscht worden sind.

Es gibt auch eine Verpflichtung gemäß DSGVO, auf Anfragen von Einzelpersonen innerhalb eines Monats zu reagieren. Hier können Probleme wie Ransomware-Angriffe dazu führen, dass Unternehmen für beträchtliche Zeit keinen vollständigen Zugang zu ihren Daten besitzen. Zudem sind auch Backups nicht länger vor Angriffen gefeit. Dabei geraten vor allem NAS (Network Attached Storage)-Systeme in den Fokus.

Fortgeschrittene Malware zerstört die Sicherungskopien und Wiederherstellungspunkte, bevor die Produktionsumgebung verschlüsselt wird.

Die Angreifer nutzen dafür häufig Schwachstellen bei veralteten Backup-Lösungen aus, die vor dem Aufkommen von Ransomware entwickelt wurden. So wird veraltete Backup-Infrastruktur häufig zur leichten Beute für Malware – statt die Daten nach einem Angriff wiederherzustellen.“

Moderne Security-Maßnahmen

Für eine Ransomware Protection der Backups sind beispielsweise eine DataLock- beziehungsweise WORM-Funktion (Write Once Read Many) wichtig. Dies gewährleistet, dass sich die Sicherungskopie nicht löschen, überschreiben oder verändern lässt – nicht einmal von internen Systemadministratoren. Damit bewahren Unternehmen Backups in einem sicheren und vor allem abgeschotteten Bereich auf – ähnlich wie eine Offline-Kopie.

Dabei werden die Backups in unveränderlichen Snapshots gesichert. Dies verhindert, dass sie von einem externen System gemountet werden. Obwohl Ransomware durchaus in der Lage sein kann, Dateien im gemounteten Backup zu löschen, kann sie einen unveränderlichen Snapshot nicht beschädigen. Während der Übertragung ist darauf zu achten, die Daten mit TLS- und SSL-Verschlüsselung vor Ransomware-Angriffen zu schützen. Zudem sind häufige Backups, etwa alle fünf Minuten, durchzuführen und die Daten im Ruhezustand mindestens mit einem 256-bit Schlüssel wie dem AES-256 CBC Standard, optional mit FIPS-Zertifizierung, zu verschlüsseln.

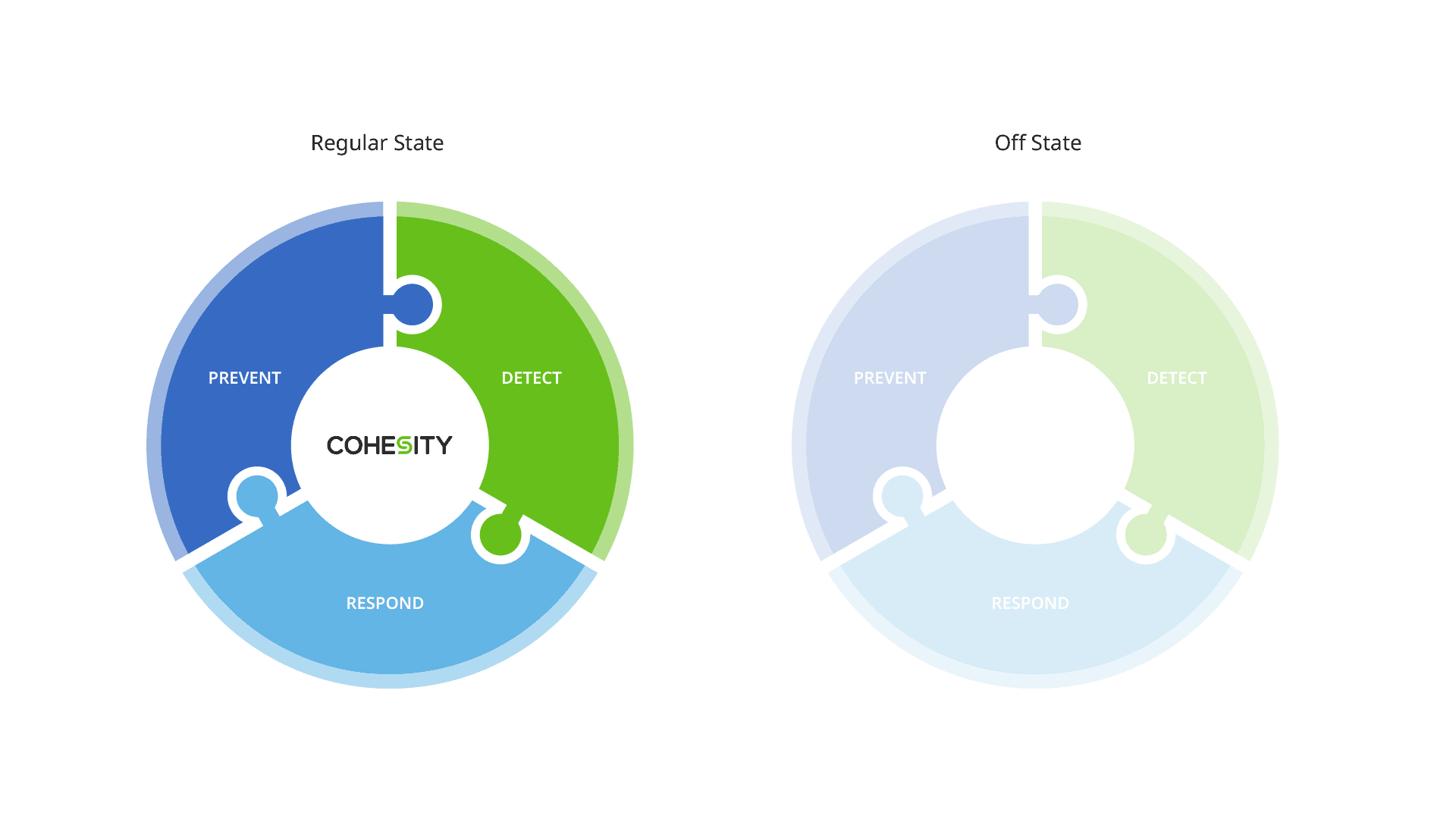

Backup-Systeme können aber auch Angriffsversuche entdecken. So analysieren aktuelle Lösungen die innerhalb der Produktionsumgebung gespeicherten Daten. Sie ermitteln, ob größere Änderungen vorgenommen wurden, die auf einen Angriff hindeuten. Dazu untersuchen sie die tägliche Änderungsrate bei logischen und gespeicherten Daten – nach der Deduplizierung – sowie die Muster bei historischen Daten und die Häufigkeit von Dateizugriffen durch einen Nutzer oder eine Anwendung. Ein modernes System kann sogar VMs auf offene Schwachstellen scannen, um proaktiv Bedrohungen zu verhindern.

Cohesity

Überblick für die Daten gewinnen

Finanzunternehmen sollten aber nicht nur moderne Backup-Lösungen einsetzen, um ihre Datensicherheit zu erhöhen, sondern auch die Compliance zu unterstützen. Die größte Herausforderung bildet dabei die Transparenz. Denn meist kommen für einzelne Anwendungen verschiedene Systeme zum Einsatz, die kaum oder gar keine Daten gemeinsam nutzen. Gemäß einer Umfrage von ESG speichern 73 Prozent der Unternehmen ihre Daten dabei zusätzlich zu ihren eigenen Rechenzentren in mehreren Public Clouds. Entsprechend verteilen sich die Daten in zahlreichen Kopien über die Systeme hinweg.

Dies kann einerseits – durch Inkonsistenzen zwischen den Kopien, ihrer Kodierung, Speicherung und ihrem Zugriff – zu Problemen bei Geschäftsprozessen führen. Andererseits wissen die meisten Unternehmen nur wenig darüber, wo sich ihre Daten befinden, wer sie verwendet oder ob sie sensible Informationen enthalten. Doch wie sollen Finanzinstitute dann die Einhaltung der DSGVO-Vorschriften überwachen oder Ransomware Protection für ihre Backups gewährleisten? Dies funktioniert nur mit umfassender Transparenz.

Cohesity

Hier kann sich das Finanzwesen ein Beispiel an Amazon, Google oder Facebook nehmen. Um mit den riesigen Datenmengen zurechtzukommen, nutzen sie eine einheitliche Datenmanagement-Architektur auf Basis von handelsüblicher Hardware, auf der alles virtualisiert und softwaredefiniert ist. Sie umfasst eine moderne Datenverwaltungsschicht, die folgende Elemente besitzt:

- Ein einheitliches Dateisystem zur konsistenten Speicherung von Daten, unabhängig von Standort, Technologie oder Anwendung. Auf Basis einer gemeinsamen Datenplattform für mehrere Anwendungsfälle können Finanzinstitute ihre Abläufe stark optimieren. Zudem lassen sich bereits während der Speicherung automatisch Inkonsistenzen erkennen und über das File System korrigieren. Lösungen wie SpanFS gewährleisten sowohl für Backups als auch für File Services hundertprozentige Datenkonsistenz.

- Eine einzige logische Steuerungsebene zur Verwaltung. Bei herkömmlichen Lösungen führen verschiedene IT-Komponenten zu hohem Management-Aufwand. Eine Scale-Out-Architektur ermöglicht es dagegen, aus einer Steuerungsebene heraus alle Daten zentral zu verwalten. Dies ist unabhängig davon, wo diese gespeichert werden.

- Die Datendienste werden unabhängig davon ausgeführt und bereitgestellt, wie Anwendungen sie benötigen. Mit einem Scale-Out File System lassen sich verschiedene Applikationen über eine zentrale Datenmanagement-Lösung verwalten – optimiert für individuelle Use Cases. Damit können Unternehmen Aufwand reduzieren, Daten konsolidieren, Kosten einsparen, Prozesse vereinfachen und den Zugriffsschutz verbessern.

Umfassende Lösung

Pascal Brunner ist seit Anfang 2017 bei Cohesity (Webseite) tätig und verantwortet als Technical Field Director die technologische Strategie und Weiterentwicklung im europäischen Markt. Er verfügt über 20 Jahre IT-Erfahrung auf Kunden- und Herstellerseite – von Beginn an mit Fokus auf den Bereich des Daten-Managements.

Pascal Brunner ist seit Anfang 2017 bei Cohesity (Webseite) tätig und verantwortet als Technical Field Director die technologische Strategie und Weiterentwicklung im europäischen Markt. Er verfügt über 20 Jahre IT-Erfahrung auf Kunden- und Herstellerseite – von Beginn an mit Fokus auf den Bereich des Daten-Managements.Statt einzelne Produkte für Backup und Restore, Archivierung, File Shares und Object Stores einzusetzen, sollten Finanzinstitute übergreifende Plattformen für die Continuous Data Protection nutzen, die das eigene Rechenzentrum, die Cloud und den Netzwerkrand – etwa die IT in Filialen oder Bankautomaten – umfassen. So konsolidieren sie ihre Backups, Datei- und Objektfreigaben für Entwicklung, Test und Analysen auf einer webbasierten Management-Plattform. Zudem ermöglicht eine Google-ähnliche Suche die schnelle Identifizierung einzelner Dateien.

Über eine Multiprotokoll-Unterstützung verwalten Finanzdienstleister mehrere Workloads mit NFS-, SMB- und S3-Kompatibilität sowie sequentielle und zufällige IOs. Dabei eliminieren sie unnötige Datenkopien und stellen kostenlose Klone für Entwicklung und Test in Echtzeit bereit. Zudem können sie über ein einziges Dashboard individuelle Richtlinien umsetzen, unterbrechungsfreie Upgrades durchführen sowie alle Standorte und Cluster verwalten. Dadurch vereinfacht sich das Datenmanagement erheblich.

Technisch basiert diese Lösung auf einer Architektur aus Knoten. Diese Server stellen CPU, Flash-Speicher und Hard Disks bereit. Die Knoten werden zu Clustern zusammengefügt, die das File System zur Datenspeicherung bereitstellen. Bei dieser API-First-Architektur wird jeder Befehl für Backup, File Server oder Applikation über einen API Call angesteuert – ohne manuelle Ausführung über das User Interface. Das ermöglicht eine einfache Integration in Orchestrierungsplattformen. Die softwaredefinierte Lösung ist dabei unabhängig von der verwendeten Hardware. So lässt sie sich sowohl für das zentrale Rechenzentrum als auch Außenstandorte oder die Cloud flexibel skalieren.

Fazit

Einheitliches Datenmanagement spart nicht nur Geld durch einen umfassenden Speicherpool, sondern lässt sich auch wesentlich effizienter, sicherer und einfacher nutzen. Es entstehen weniger Kopien und die Transparenz ist gewährleistet, indem dieselben Backup- und Archivierungstechnologien auf die gesamte Infrastruktur angewendet werden. Da die Lösungen zudem softwaredefiniert sind, lassen sie sich auch bei einer bestehenden Infrastruktur mit minimaler Unterbrechung implementieren und verwalten, sei es im eigenen Rechenzentrum, in der Cloud oder hybrid.Pascal Brunner, Cohesity

Sie finden diesen Artikel im Internet auf der Website:

https://itfm.link/114941

Schreiben Sie einen Kommentar