Vom fahrerlosen Auto bis zur Anlagestrategie: Algorithmische Versicherer – gleiche Regeln, anderes Spiel

Tibco Software

Algorithmen – sie sind fast unbemerkt in das allgemeine Bewusstsein gerutscht! Vom fahrerlosen Auto bis hin zu Anlagestrategien spielen sie nun plötzlich bei der Diskussion in Bezug auf alle Arten von Technologien und Industrien eine wichtige Rolle. In der Versicherungsbranche gehören dazu auch Lösungen, mit denen Preise und Kostenvoranschläge für neue Versicherungsgeschäfte ermittelt, der Umgang mit Ansprüchen automatisiert und Betrugsfälle aufgedeckt werden.

von Diplom-Informatiker(FH) Wolfgang Kelz, VP Solution Consulting EMEA, Tibco

Aber was sind Algorithmen und warum stehen sie plötzlich so im Rampenlicht? Welche Auswirkungen ergeben sich aus dem Einsatz von Algorithmen für vertikale Märkte wie der Versicherungsbranche und welche Herangehensweise empfiehlt sich dabei für Unternehmen?

Mathematische Formeln sind neben Kochrezepten ein gutes Beispiel für Algorithmen. Ebenso wie Modelle wenden diese Mathematik auf Rohdaten an, um bestimmte Ziele zu erreichen.“

Das Modell ‚Random Forrest’ beispielsweise ist in der Lage, Rohdaten zu finden, welche die für das beabsichtigte Ziel vorausdeutenden Fähigkeiten haben. Damit können rauschende Variablen oder verschmutzte Daten ignoriert werden. Es bedarf keiner a priori Annahmen bezüglich der Daten und das Modell kann so zweifelsfrei auch im Geschäftsbereich angewandt werden.

Übertragen auf die Versicherungsbranche werden Algorithmen und Modelle in Form von spezifischen Apps, beispielsweise einem Pricing Accelerator genutzt.“

Das Ziel dabei ist es, dynamisch Rabatte auf Versicherungsprodukte anzuwenden und zwar auf der Grundlage der Kundenveränderungen oder der Wahrscheinlichkeit der Kundenbeibehaltung. Der optimale Rabatt für eine solche Prämie kann durch die Nutzung von klassisch-logistischen Regressionsmodellen in Verbindung mit anderen beaufsichtigten Maschinenlernalgorithmen geschätzt werden. Letztere nutzen Versicherer auch dazu, um die Wahrscheinlichkeit zu ermitteln, dass ein Kunde ein Produktangebot annimmt bzw. erneut abschließen wird. In tatsächlichen Implementierungen können Techniken wie der LASSO Regression (Least Absolute Shrinkage and Selection Operator) verwendet werden, um zu garantieren, dass Rabatte über Geschlechter und Altersgruppen ausgeglichen werden, wie es die Gesetzgebung erfordert. Das Modell mit der besten Leistung wird eingesetzt, um Echtzeit-Preisangebote zu unterstützen.

Wolfgang Kelz ist Diplom-Informatiker (FH) und VP Solution Consulting EMEA bei Tibco. Er begann seine Karriere bei Tibco im Jahr 2001 als Leiter der Pre-Sales-Organisation. Vier Jahre später übernahm er die Führung des Bereichs Solutions Consulting in Zentral- und Osteuropa. Als Leiter der Architecture Service Group in Europa war er von 2009 an für die Auswahl und Einführung unternehmensweiter Tibco-Lösungen bei strategischen Kunden verantwortlich.

Wolfgang Kelz ist Diplom-Informatiker (FH) und VP Solution Consulting EMEA bei Tibco. Er begann seine Karriere bei Tibco im Jahr 2001 als Leiter der Pre-Sales-Organisation. Vier Jahre später übernahm er die Führung des Bereichs Solutions Consulting in Zentral- und Osteuropa. Als Leiter der Architecture Service Group in Europa war er von 2009 an für die Auswahl und Einführung unternehmensweiter Tibco-Lösungen bei strategischen Kunden verantwortlich.Vor seinem Eintritt bei Tibco arbeitete er als Berater, Projektleiter und Bereichsleiter bei verschiedenen Softwareunternehmen mit Schwerpunkt auf prozessorientierte Integrationslösungen in heterogenen IT-Landschaften.

Beaufsichtigte Modelle eignen sich neben der Preiskalkulation auch für Cross- und Up-Selling sowie für automatisiertes Anspruchs- und Betrugsmanagement. Als Basis dienen dabei historische Daten, die den vorherzusagenden Wert enthalten, d.h. wie beispielsweise: der Kunde hat eine Haustierversicherung gekauft oder nicht, ein Versicherungsanspruch sollte sofort ausbezahlt werden oder nicht. Alle verfügbaren Daten werden dann genutzt, um ein Muster zu identifizieren, mit der die Gruppen unterschieden werden können. In einem weiteren Schritt kann dieses Muster auf ähnliche, aber aktuelle Daten angewendet werden, um das Kunden- bzw. Claim-Verhalten in Echtzeit vorherzusagen. Bekannte Algorithmen wie Neural Network, Generalised Linear Modes, Logistic Regression, Random Forrest oder XGBoost fallen in diese Gruppe.

Ein weiterer wichtiger Fall für die Verwendung von Algorithmen in der Versicherungsbranche ist die Portfolio-Bewertung. Zum Beispiel sind die Versicherer bei der Verwaltung der Vermögenswerte in einer Pensionskasse verpflichtet, Risiken und den Portfoliowert unter diesen Risiken konsequent abzuschätzen. Für solche Risikobewertung sind Monte-Carlo-Simulationen sehr beliebt. Diese ermöglichen es, Proben aus den Wahrscheinlichkeitsverteilungen derjenigen Faktoren zu ziehen, die ein Ergebnis beeinflussen.

Dieses Vorgehen lässt sich am ehesten mit einem Beispiel aus der Finanzbranche darstellen und erläutern: Der Wert eines Portfolios hängt vom risikofreien Zins des Marktes ab. Wenn ein Vermögenswert langfristig gehalten werden soll, verändert sich mit einem schwankenden Zinssatz zwangsläufig auch der Wert. Mit Monte Carlo kann eine Stichprobe für die wahrscheinlichen Werte des Zinssatzes gezogen und dann der Wert des Portfolios berechnet werden, sofern diese unterschiedlichen Annahmen vorliegen. Auf dieser Basis können schließlich Zeichnungswertverteilungen für die vorhandenen Vermögenswerte und die Schätzung der jeweiligen Verlustwahrscheinlichkeit erfolgen.

Für Finanzinstitute (FSIs) ist so ein Vorgehen von Vorteil. Rechtsverordnungen schreiben vor, dass Finanzinstitute genügend Reserven halten müssen, um diese Wahrscheinlichkeit unter einem vordefinierten Niveau zu halten. Es ist daher üblich für FSIs, massive Simulationen über Hypercomputer wie TibcoS HPCCA (High Performance Cloud Computing Adapter) durchzuführen.

Viele der Anwendungen stammen aus einer Zelt, in der Versicherungsprodukte üblicherweise über einen Vertreter vermittelt wurden und haben sich nun weitestgehend auch für den direkten Online-Verkauf einsetzen lassen. Jedoch bringt die Marktentwicklung heute neue Herausforderungen mit sich:

Schnell steigende Transaktionsvolumina verlangsamen die Reaktionszeiten und setzen die Anwendungen großer Belastung aus. Gleichzeitig wachsen die Ressourcen zur Risikokalkulation in ihrer Komplexität. Kundenerwartungen ändern sich durch eine steigende Zahl an offenen Interaktionskanälen in ähnlicher Weise.“

Das Ergebnis ist ein von nicht mehr zweckgemäßen Legacy-Anwendungen angetriebener Online-Versicherungsmarkt. Allerdings zeichnen sich bereits Veränderungen ab. Versicherer versuchen sich an diese schnelllebige und sich schnell entwickelnde digitale Umgebung anzupassen. Dies erfordert jedoch ein grundlegendes Umdenken zu einer verbesserten Bedienbarkeit des Marktes. Versicherer greifen beispielsweise zunehmend auf private und öffentliche Cloud-Dienste zurück.

Denken ’inside the box’

Historisch gesehen wurde der Markt für Versicherungs-Software von wenigen Fachanbietern dominiert, deren Produkte sowohl teuer zu implementieren als auch ohne Einbindung einer IT-Abteilung schwer anzupassen waren. Führende Versicherungsunternehmen nutzen im Grunde alle die gleichen Algorithmen, um Risiken zu kalkulieren und zu bewerten. IT-Abteilungen betreiben diese weitgehend als “Black-Box“-Lösungen, wobei man nur geringe Möglichkeiten für logische, schnelle Feinabstimmungen hat, um auf Markttrends und Gesetzesänderungen zu reagieren oder Versicherungsprodukte für Wettbewerbsvorteile zu differenzieren.

Die Suche nach dem richtigen Algorithmus erfordert immer eine sehr klare Problemformulierung als Ausgangsbasis. Das umfasst neben dem Problemverständnis auch die Daten (Inhalt, Größe und Quelltyp) sowie das erforderliche Ziel oder die Ziele. Die Kombination dieser drei Faktoren ermöglicht die Identifikation einer Auswahl an relevanten Techniken: Clustering oder überwachtes Lernen, Simulation oder Optimierung u.a. Im Anschluss müssen die Daten organisiert und letztendlich einer oder mehrere Algorithmen der Technik angewendet werden, damit die Ergebnisse in einer unparteiischen Aufstellung bewertet werden können.

Letztendlich können ältere Versicherungsanwendungen daher nur schwer in eine moderne IT-Infrastruktur, die eine Mischung aus öffentlicher und privater Cloud sowie On-premise-Plattformen umfasst, integriert werden. Das schafft wiederum Barrieren, wenn es um die Automatisierung und Straffung von Geschäftsprozessen geht – eine wachsende Anforderung, da sich die Unternehmen in Richtung einer breiteren digitalen Transformation bewegen.

Denken ’outside the „black“ box’

Der erste Schritt in Richtung notwendiger Veränderung setzt dabei die Abkoppelung aller Vorgänge voraus, die mit den Algorithmen zusammenhängen. Dadurch werden diese unabhängig von den eingesetzten Anwendungen verfügbar. Der zweite notwendige Schritt sieht die Einrichtung sogenannter Insight Platforms vor. Diese sind in der Lage, fortgeschrittene Datenanalytik zu verwenden, um sowohl Trends zu finden und Einsichten zu liefern, als auch darauf zu reagieren und Prozesse voranzutreiben. Diese Plattformen bieten die benötigten Werkzeuge in Form einfacher Bausteine, die mit flexiblen, fertigen oder selbstgefertigten Algorithmen verbunden werden können. So werden skalierbare und dennoch agile Anwendungen entwickelt, die den Anforderungen des modernen digitalen Geschäfts über ein breites Spektrum an unterschiedlichen Industrien gerecht werden können.

Grundlage hierfür bilden Algorithmen, die fähig sind, sich weiterzuentwickeln. Alle maschinellen Lernalgorithmen, einschließlich des Deep Learning sind eine Form der künstlichen Intelligenz. Sie erlauben dem Algorithmus auf veränderte Umstände zu reagieren und sich im Laufe der Zeit zu verbessern.

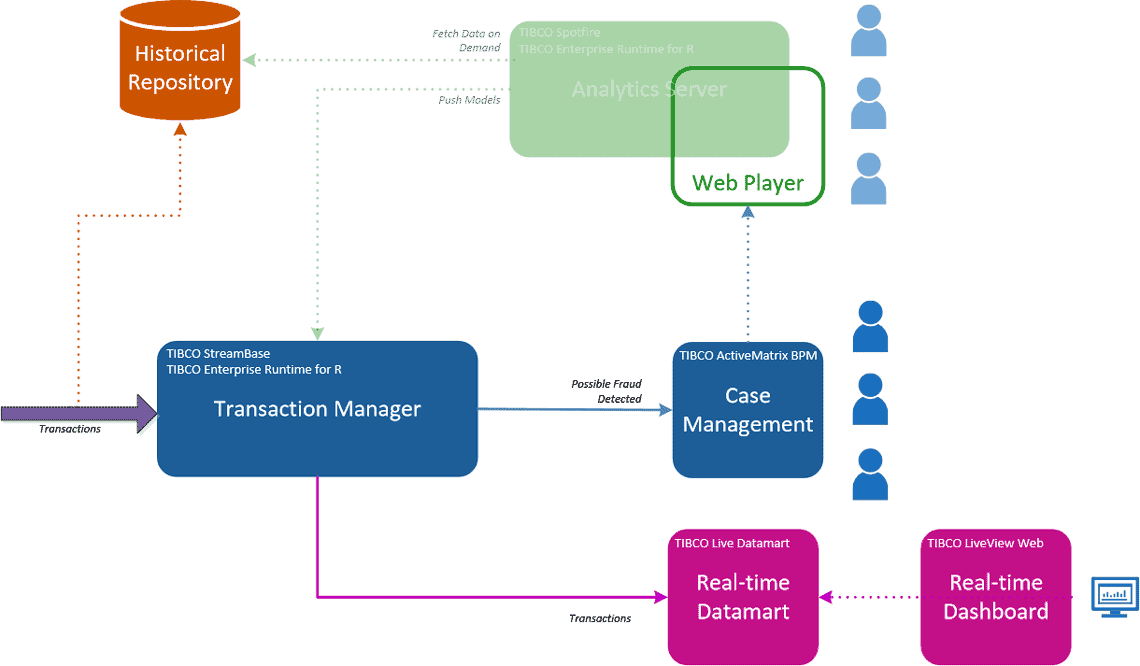

Die technische Architektur für das maschinelle Lernen in einer Geschäftsumgebung muss einige Grundbedingungen erfüllen. Erstens muss der Zugang zu historischen Daten und zweitens eine gewisse Handlungsfähigkeit gegeben sein. Werden Aktionen in Echtzeit gefordert, so braucht es eine Lösung, die ein Modell in Echtzeit anwenden kann. Zu guter Letzt benötigt man die Fähigkeit, Geschäftsprozesse zu starten und zu verfolgen. Wenn die künftige Nachvollziehbarkeit von Maßnahmen wichtig ist oder komplexe Geschäftsprozesse als Handlung festgelegt werden, ist ein Business Process Management erforderlich.

Tibco

Für die Risikomodellierung wiederum kann die Architektur sehr unterschiedlich sein. Sollen gleichzeitig unabhängige Berechnungen parallel auf Supercomputer-Systemen gestartet werden sollen, sind spezielle Lösungen notwendig.

Mit Insight Platforms können Unternehmen sich die wachsende algorithmische Wirtschaft zu nutze machen, indem sie Anwendungen dafür selbst entwickeln und verwalten. Solche Anwendungen kosten nur einen Bruchteil der vorhergehenden „Black Box“-Alternativen. Sie geben den Unternehmen auch die Freiheit zurück, ihre geschäftlichen Anforderungen so zu lösen, wie sie das möchten und brauchen: in ihrem Tempo, bei voller Kontrolle und in einem Format, das bereit ist für den nächsten Schritt vom algorithmischen zum autonomen Handel.aj

Sie finden diesen Artikel im Internet auf der Website:

https://itfm.link/53950

Schreiben Sie einen Kommentar